Praxisbeispiel: Wie Medienhäuser Künstliche Intelligenz einsetzen

Künstliche Intelligenz ist das dominierende Thema in der Medien- und Kommunikationsbranche. Kein Tag, an welchem nicht ein neues Tool oder eine innovative KI-Plattform präsentiert wird.

Weshalb Künstliche Intelligenz kein Hype ist

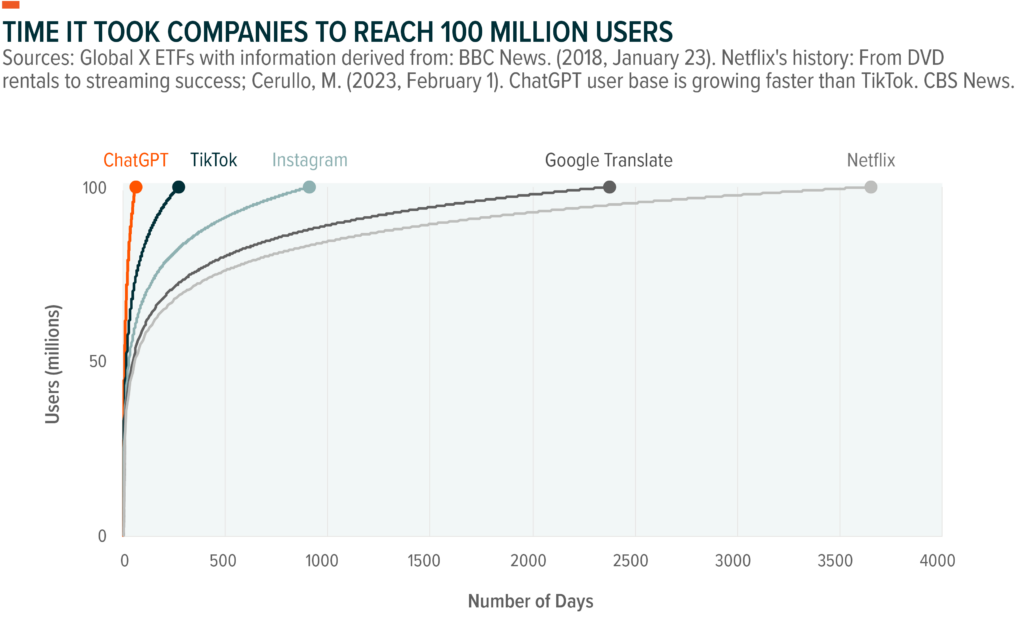

Im Unterschied zum Metaverse-Hype oder der Blockchain-Hoffnung hat die KI-Technologie aber das Potential, nachhaltig die Branche zu verändern. Das hängt vor allem mit dem Adaptionstempo und der Breitenwirkung zusammen. Gerade mal 60 Tage dauerte es, bis die KI-Anwendung ChatGPT 100 Millionen Menschen erreichte. Kaum eine andere Technologie war so schnell.

Diese schnelle Adaption begründet sich hauptsächlich durch die vermeintliche Allwissenheit von ChatGPT. Der KI-Chatbot liefert auf fast alle Fragen eine überzeugende Antwort. Damit wurden über Nacht einer breiten Öffentlichkeit die Möglichkeiten der Künstlichen Intelligenz erkennbar und zugänglich gemacht. Plötzlich genügte eine einfach gestellte Frage, um Quantenphysik im Stil von Shakespeare zu erklären, unübersichtliche Datensätze auszulesen oder einen komplexen Code zu entwickeln.

Erst schrittweise erkennen wir allerdings auch die Grenzen der Technologie. Unterdessen haben viele Nutzer:innen verstanden, dass ChatGPT vor allem als Kreativ-Assistenz dienen kann. Wenn es aber um Fragen mit einer klaren Wahrheits-Aussage geht, ist die Technologie bisher noch überfordert – getreu dem Spaghetti-alla-Carbonara-Problem.

Doch ChatGPT ist nicht der einzige Grund für das hohe Adaptionstempo von KI. Unterdessen gibt es eine Vielzahl von KI-Tools und -Anwendungen, die unsere Arbeit erleichtern oder gar überflüssig machen soll. Hier finden Sie eine Auflistung von KI-Tools für Medienschaffende.

Einsatzmöglichkeiten von KI in der Medien- und Kommunikationsbranche

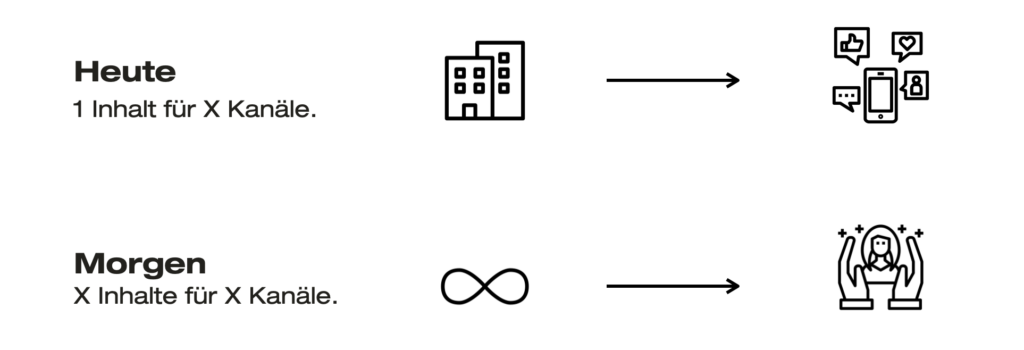

Wir befinden uns deshalb an einem aus technologischer Sicht historischen Punkt. Künstliche Intelligenz beginnt, die bisherige Medien-Logik umzudrehen: Was früher nur als «one to many» funktionierte (ein Inhalt für X Kanäle) wird dank KI plötzlich zum «many to one» (X Inhalte für meinen ganz persönlichen Kontext).

So zeigt sich, dass bereits heute KI-Tools im Medien- und Kommunikationsbereich zahlreiche Prozesse vereinfachen. In einer Umfrage der World Association of News Publishers gab die Hälfte der befragten Newsroom-Verantwortlichen an, regelmässig ChatGPT oder ähnliche KI-Systeme in der täglichen Arbeit einzusetzen. Doch nur 20% der befragten Unternehmen haben Richtlinien für die Nutzung solcher Tools erstellt.

Der Anwendungsbereich von KI-Technologien in Medienhäusern ist vielseitig. Hier finden Sie für die Inhalteproduktion relevante KI-Einsatzgebiete und Praxisbeispiele.

Künstliche Intelligenz zur Themenrecherche und -analyse

KI-Tools können helfen, um relevante Themen ausfindig zu machen und diese zum richtigen Zeitpunkt einzuplanen.

💡 Die Rheinische Post setzt seit mehreren Jahren ein Social-Listening-Tool (Listening Center) für die Themenrecherche ein.

Seit Anfang 2021 hilft bei Focus Online ein KI-System, Inhalte lösungsorientierter zu gestalten.

Künstliche Intelligenz zur Inhaltserstellung

News-Artikel, Wetterberichte, Sportergebnisse und Börsenberichte können bereits heute mithilfe von KI automatisiert erstellt werden.

💡 Bereits 2014 begann die Wirtschaftsredaktion der Nachrichtenagentur AP, Berichte über Unternehmensgewinne zu automatisieren. Unterdessen hat AP KI-Tools in ganz unterschiedlichen Prozessschritten integriert: von der Erkennung von News-Ereignissen, über Echtzeit-Transkription, automatisierte Zusammenfassungen bis hin zur Bilderkennung.

Thomson Reuters hat jüngst eine Kooperation mit Microsoft angekündigt, um schneller juristische Fragestellungen klären zu können.

Künstliche Intelligenz zur Publikation von Inhalten

Wann ist der richtige Zeitpunkt und welches der richtige Kanal für die Publikation eines Inhaltes? KI-Tools können unterdessen bereits Vorhersagen über die potentielle Reichweite und Abo-Konversion eines Artikels berechnen.

💡 Die FAZ setzt seit 2022 KI-Tools ein, um zu prognostizieren, wie gut ein Artikel gelesen wird und daraus abzuleiten, ob ein Artikel gratis oder kostenpflichtig angeboten werden sollte.

Künstliche Intelligenz zur Distribution von Inhalten

Weshalb muss die Form und der Zeitpunkt einer Medienpublikation fix sein? KI kann helfen, diese bisher festgeschriebenen Medienformen und Nutzungsmuster zu durchbrechen.

💡 NPR hat einen Chatbot basierend auf zahlreichen Podcast-Episoden erstellt. Damit ermöglicht das Medienhaus einen sehr viel persönlicheren Zugang zu bereits bestehenden Recherchen und Inhalten.

Einen Schritt weiter geht die App Artifact, hinter welcher die ehemaligen Instagram-Gründer stecken. Die App bietet ein personalisiertes News-Erlebnis, ermöglicht KI-basierte Artikel-Zusammenfassungen und Umformulierungen von Clickbait-Titeln.

Künstliche Intelligenz für das Community Management

Während viele Medienhäuser ihre Kommentarmöglichkeiten in den vergangenen Jahren eingeschränkt haben, kann KI helfen, das Community Management zu vereinfachen und die Qualität in Online-Diskussionen zu verbessern. So war die Kommentar-Moderation in den letzten Jahren oft einer der ersten KI-Einsatzbereiche in Newsrooms.

💡 Die Washington Post hat seit 2017 ein eigenes KI-Moderationstool (ModBot) in Betrieb. Diese Technologie wurde mit den Daten der Kommentar-Moderation trainiert, welche während Jahren zuvor manuell erfolgte.

Welche Regeln sich Medienhäuser im Umgang mit KI auferlegen

Eine Branche, deren grösstes Gut das Vertrauen ist, muss im Umgang mit Künstlicher Intelligenz ein ganz besonderes Augenmerk auf ethische Fragestellungen legen. Richtlinien im Zusammenhang mit dem Einsatz von KI-Anwendungen klären die Verantwortung, schützen vor Missbrauch und fördern die Transparenz.

Dazu gehören zum Beispiel die Identifizierung und Minimierung von Biases oder auch die Transparenz von zugrundeliegenden Datensets, mit welchen KI-Tools trainiert wurden.

Einige Medienhäuser gehen mit gutem Beispiel voran und haben sich in den letzten Jahren und Monaten selbst Regeln im Umgang mit KI-Anwendungen auferlegt. Hier finden Sie eine Übersicht.

Guidelines der dpa im Umgang mit KI

Die Deutsche Nachrichtenagentur dpa hat sich bei der Entwicklung von Guidelines an die eigenen Werte zurückbesinnt und sich gefragt: Wie passen diese mit KI-Entwicklungen zusammen? Daraus entstanden fünf Regeln – hier ein Auszug davon:

- Die dpa setzt KI zu verschiedenen Zwecken ein und steht dem verstärkten Einsatz von KI aufgeschlossen gegenüber.

- Die dpa setzt KI nur unter menschlicher Aufsicht ein. Die letzte Entscheidung über den Einsatz von KI-basierten Produkten trifft ein Mensch.

- Die dpa setzt nur rechtmässige KI ein, die sich an geltendes Recht und gesetzliche Bestimmungen hält und die unseren ethischen Grundsätzen gerecht wird.

- Die dpa setzt KI ein, die technisch robust und sicher ist, um die Risiken für Fehler und Missbrauch zu minimieren.

- Die dpa ermuntert alle Mitarbeiter:innen, sich offen und neugierig mit den Möglichkeiten von KI zu befassen.

Guidelines von DER SPIEGEL im Umgang mit KI

In ähnlichem Stil wie die dpa hat sich DER SPIEGEL mit den Chancen und Risiken von Künstlicher Intelligenz auseinandergesetzt. Das Medienhaus will Künstliche Intelligenz in erster Linie «sinnvoll einsetzen, um das Angebot für Nutzer:innen zu verbessern und die internen Abläufe effizienter zu gestalten».

Aus den internen Diskussionen sind folgende Leitlinien für die Redaktion, die Dokumentation, die Produktentwicklung und den Vertrieb entstanden – hier ein Auszug:

- Wir wollen uns den Möglichkeiten, die KI-Systeme bieten, (…) mit grosser Offenheit nähern und unsere Teams genauso wie einzelne Mitarbeitende ermutigen, sich damit auseinanderzusetzen.

- Das Vertrauen unserer Nutzerinnen und Nutzer in unseren Journalismus ist unser wichtigstes Gut. Wie bei jeder Technologie, die wir einsetzen, gilt: Wir sind für alle unsere Inhalte verantwortlich.

- Wir setzen künstliche Intelligenz in unseren eigenen Produkten niemals ohne Aufsicht oder klare Spielregeln ein und prüfen, ob das Resultat unseren strengen Ansprüchen an Faktentreue, Ausgewogenheit und kritische Unabhängigkeit gerecht wird.

Guidelines des Bayerischen Rundfunks im Umgang mit KI

«Egal welche Technologie bei uns zum Einsatz kommt, sie soll kein Selbstzweck sein. Sie muss uns helfen, besseren Journalismus zu machen.» So umschreibt der Bayerische Rundfunk bereits seit November 2020 den Einsatz von Künstlicher Intelligenz in der Redaktionsarbeit.

Dabei bildet die Frage nach dem tatsächlich geschaffenen Mehrwert von KI-Anwendungen bei Mitarbeitenden und Nutzer:innen der Prüfstein aller Entscheide. Um diese Frage beantworten zu können, haben sich die BR-Verantwortlichen 10 ethische Richtlinien gegeben – hier ein Auszug:

- Wir nutzen KI, um unsere Arbeit effizienter zu machen, verantwortlich mit den Ressourcen umzugehen, (…) um neue Inhalte zu generieren, neue Methoden für investigative Recherchen zu entwickeln und Angebote für unsere Nutzer:innen attraktiver zu machen.

- Wir beteiligen uns an der Debatte über die gesellschaftliche Rolle von Algorithmen, indem wir über Trends informieren, KI-Entwicklungen einordnen, investigativ zu Algorithmen recherchieren, Funktionsweisen erläutern und eine offene Diskussion über die Weiterentwicklung der öffentlich-rechtlichen Medienarbeit in der Daten-Gesellschaft befördern.

- Wir denken stets die gesellschaftliche Vielfalt Bayerns und Deutschlands mit. So streben wir nach (…) einem aufmerksamen und bewussten Umgang mit möglichen Vorurteilen in Trainingsdaten (algorithmic accountability), auch durch möglichst diverse Teams.

- Bewusste Datenkultur: Wir verlangen von Dienstleistern belastbare Informationen zu den Datenquellen: Womit wurde das Modell trainiert?

- Personalisierung stärkt den Informations- und Unterhaltungswert unserer Angebote, sofern sie gesellschaftliche Vielfalt nicht untergräbt und ungewollte Filterblasen-Effekte verhindert.

- Redaktionelle Kontrolle: Auch bei automated journalism und Datenjournalismus liegt die publizistische Verantwortung bei den Redaktionen.

- Agile Lernkultur: Um Produkte und Richtlinien weiterzuentwickeln, brauchen wir Lernerfahrungen aus Pilotprojekten und Prototypen.

- Wir arbeiten in Kooperation mit Hochschulen und Universitäten an Projekten wie Textgenerierung und Machine-Learning-Modellen und bieten Studierenden und Lehrenden praktische Kontexte für Forschungsarbeiten.

- Talente und Kompetenzen: Angesichts des dynamischen Technologiespektrums der KI stellen wir aktiv sicher, dass wir im BR ausreichend Mitarbeiter:innen haben, die den verantwortungsvollen und menschenzentrierten KI-Einsatz auf neuestem Stand umsetzen können.

- Interdisziplinäre Reflexion: Anstatt Ethik-Reviews zu machen, nachdem Ressourcen investiert wurden, integrieren wir die interdisziplinäre Reflexion mit Journalist:innen, Entwickler:innen und dem Management von Beginn an in die Produktentwicklung.

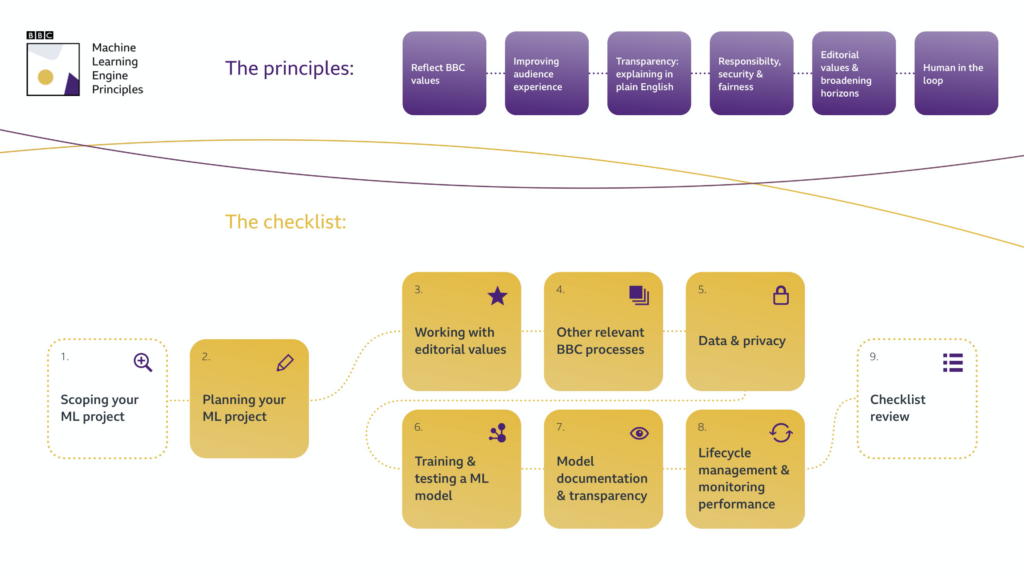

Guidelines der BBC im Umgang mit KI

Ebenfalls zu den Early Adoptern gehört die BBC: Im Mai 2021 hat sich das Medienhaus Prinzipien zum Umgang mit KI auferlegt. Diese wurden in der Forschungs- und Entwicklungsabteilung aufgesetzt und richten sich entsprechend nicht nur an die internen Nutzer:innen von KI-Anwendungen, sondern bestehen auch aus einer Checkliste zur Selbstprüfung für Entwicklungs-Teams (Igenieur:innen, Datenwissenschaftler:innen, Produktmanager:innen usw.).

Das Rahmenwerk basiert auf den Werten des öffentlichen Dienstes und soll möglichst praxisorientiert einen nützlichen Beitrag zur Entwicklung einer verantwortungsvollen KI leisten. Folgende sechs Leitprinzipien umfasst die Regelung:

Ausserdem ist die BBC seit Anfang 2023 Teil eines Konglomerats von 10 Unternehmen, die sich zu mehr Transparenz im Bereich der generativen KI bekennen. Nebst der BBC gehören u.a. auch OpenAI (die Firma hinter ChatGPT), TikTok, Adobe, die Dating-App Bumble und CBC/Radio-Canada zu diesem Verbund.

Guidelines von WIRED im Umgang mit KI

Das Technologiemagazin WIRED ist schon nur aufgrund seiner DNA eng mit technologischen Neuerungen verbunden. So ist es nicht weiter erstaunlich, dass die Macher:innen von sich sagen: «Wir wollen an der Spitze der neuen Technologien stehen, aber auch ethisch korrekt und angemessen umsichtig handeln.»

Im Mai 2023 haben sich die Verantwortlichen bei WIRED acht Regeln im Umgang mit Text- und Bildgenerierungs-Tools gegeben:

- Wir veröffentlichen keine Artikel in denen der Text einzig von einer Künstlichen Intelligenz generiert wurde – ausser falls dieser Fakt der eigentliche Sinn des Artikels ist.

- Wir veröffentlichen auch keine von AI redigierten Texte.

- Wir halten uns offen, KI zu nutzen, um Überschriften oder Texte für kurze Beiträge in sozialen Medien vorzuschlagen.

- Wir halten uns offen, mit Hilfe von KI Ideen für Geschichten zu entwickeln.

- Wir experimentieren mit dem Einsatz von KI als Forschungs- oder Analyseinstrument.

- Wir halten uns offen, KI-generierte Bilder oder Videos zu veröffentlichen, aber nur wenn wir die Tatsache offenlegen, dass generative KI verwendet wurde.

- Wir verwenden ausdrücklich keine KI-generierten Bilder anstelle von Stockfotos.

- Wir oder die von uns beauftragten Künstler können KI-Tools als Ideengeber einsetzen.

Guidelines von Ippen Media im Umgang mit KI

Ohne grosse Berührungsängste hat Ippen Media Anfang 2023 als grosses deutschsprachiges Medienhaus KI-Tools für die Textproduktion eingesetzt. Mit zum Teil auch unschönen Resultaten: Im April 2023 hat die KI in einem Beitrag für ingame.de einen falschen Zusammenhang zu einem lange zurückliegenden Fakt hergestellt. Das führte dazu, dass die Redaktion ihre Prozesse bei KI-unterstützten Texten überprüfen und ihre Richtlinien anpassen musste. Auf folgende fünf Punkte haben sich die Verantwortlichen bei Ippen Media unterdessen geeinigt:

- KI-Anwendungen unterliegen unseren Werten, Normen und Zielen. Dazu gehören die redaktionellen Leitlinien oder Unternehmensrichtlinien.

- Wir begreifen KI als Fortschritt, den wir proaktiv begleiten wollen, ohne die Risiken auszublenden.

- Es gilt das Transparenzgebot gegenüber Lesern, Mitarbeitern, Kunden.

- Die Verantwortung für die Folgen von KI-Anwendungen liegt bei Unternehmen, Redaktion und Mitarbeitern.

- Das Human-in-the-Loop-Prinzip: Der Mensch ist immer im Prozess involviert. Das heisst zum Beispiel, dass redaktionelle Inhalte immer von Redakteuren geprüft und beauftragt werden.

Transparenzhinweis: Das Titelbild dieses Artikels wurde mit dem Bildgenerierungs-Tool Midjourney erstellt. Folgender Prompt wurde angewandt: award winning editorial photography, journalist working together with a robot, yellow light, working in a newsroom, other people in the background, daylight –ar 16:9 –style raw –v 5.1

Fragen? Andere Beispiele?

Setzen Sie – ausser ChatGPT – weitere KI-Tools in Ihrer täglichen Arbeit ein? Kennen Sie Beispiele von Unternehmen, welche überzeugende KI-Strategien entwickelt haben? Lassen Sie es mich gerne wissen, indem Sie die untenstehende Kommentar-Funktion nutzen oder mir auf einem anderen Kanal eine Nachricht zukommen lassen. Ich freue mich!

Einmal im Monat fasse ich Tipps und Leseempfehlungen zu Strategieentwicklung, Change Management und Transformation in einem kostenlosen Newsletter zusammen.

Rund 2500 regelmässige Abonnent:innen vertrauen bereits diesem Update für Geist und Herz. Es würde mich sehr freuen, auch Sie künftig zu meiner treuen Leserschaft zählen zu dürfen.

Jetzt anmelden

Inhaltsverzeichnis