Weshalb Algorithmen den Journalismus verbessern

Bis 2030 sollen 90 Prozent der digitalen Inhalte von Computern verfasst werden. Das ist in erster Linie eine gewagte Annahme, die den meisten Journalisten Angst macht. Sie sehen ihre Existenz gefährdet und schreiben deshalb gegen den «Roboterjournalismus» an. Doch die Entwicklung von Algorithmen birgt viele Vorteile für die redaktionelle Arbeit. Ein Überblick zum Stand der Forschung und kommenden Möglichkeiten.

Ein Schreckgespenst geht in deutschsprachigen Redaktionsstuben um. Für die einen ein Modewort, für andere eine neue Gefahr: «Roboterjournalismus». Von Blechkameraden, künstlichen Schreiberlingen und Reportern aus Plastik ist die Rede. Bereits die Versinnbildlichung dieser Begriffe zeigt: Die neue Entwicklung löst bei vielen Branchenkollegen Angst aus. Diese greift so weit, dass sogar vom Ende des Journalismus geschrieben und zur Rettung des «Biojournalismus» aufgerufen wird.

Doch eigentlich ist diese Entwicklung nichts anderes als eine logische weitere Stufe im digitalen Journalismus. Viel zu lange verharrten wir darauf, alte Strukturen ins Internet-Zeitalter zu übersetzen.

Print-Abläufe in digitalen Redaktionen, klassische Abo-Möglichkeiten und Einwegkommunikation sind nur einige wenige Ausprägungen dieser einst bestimmenden Zunft.

Dass die Integration von Algorithmen im digitalen Arbeitsablauf von Journalisten durchaus Sinn macht, allerdings auch kritisch beobachtet und unter klaren Richtlinien umgesetzt werden muss, möchte ich im Folgenden aufzeigen. Dazu habe ich drei Hauptbereiche eruiert, in welchen Algorithmen bereits zur Anwendung kommen oder demnächst eingebettet werden könnten.

Algorithmen im Breaking News-Bereich

Bereits heute werden Algorithmen für das Monitoring, die Suche und das Filtern von Breaking News in der Informationsflut angewendet. So dockt zum Beispiel der Algorithmus von Dataminr direkt bei Twitter an, um relevante Inhalte in Sekundenbruchteilen ausfindig machen zu können. Ähnlich funktioniert der Algorithmus von Storyful. Die Social Media-Agentur mit Sitz in Dublin analysiert nicht die Inhalte basierend auf der Sprache der Mitteilungen, sondern wertet ihre Umlaufgeschwindigkeit aus. Verbreitet sich ein Inhalt relativ zu anderen schneller, wird er vom Algorithmus herausgefiltert und in einem zweiten Schritt von Journalisten analysiert.

Ebenfalls auf der Basis von Veränderungen im Netz funktioniert die Entwicklung des deutschen Wissenschaftler und Google-Mitarbeiters Thomas Steiner. Er hat einen Algorithmus entwickelt, der auf Basis der Wikipedia-Veränderungen Breaking News erkennt. Auf den ersten Blick mag sein Projekt «Wikipedia Live Monitor» verwirren. Doch die Idee dahinter überzeugt. Die Wikipedia-Community – bestehend aus Tausenden aktiven Usern – ist oft die erste, die Inhalte in einer effizienten Kooperation überprüft und online aktualisiert.

Kritiker werden nun einwenden, Wikipedia können von jedem verändert werden und sei deshalb keine sinnvolle Newsquelle. Auch hierzu wurde vor wenigen Wochen ein Algorithmus vorgestellt, der genau diesem Phänomen zuvorkommt und bewussten Vandalismus am System verhindern soll.

Doch die Forschung geht noch weiter: Jüngst veröffentlichten Forscher der Universität Virginia eine Studie, in welcher Wissenschaftler anhand von Tweets in 19 von 25 Fällen kriminelle Verbrechen noch vor der Tat vorhersagen konnten. «Predictive Analytics» wird diese Art der Datenanalyse genannt, die demnächst auch von Journalisten eingesetzt werden könnte.

Algorithmen als Produktionshilfen

Algorithmen können aber nicht nur bei der redaktionellen Suche, dem Filtern und der Analyse nützlich sein, sondern auch die Produktion der Inhalte übernehmen. Diesem Bereich wurde in letzter Zeit besonders viel Beachtung zugemessen. Einige Startups versuchen, mit ständiger Optimierung ihrer Software noch bessere Texte herzustellen – und dies automatisiert, sei es im Bereich der Wirtschafts-, Sport- oder Wetterberichterstattung. Überall dort, wo auswertbare Daten entstehen, die mit einer gewissen Regelmässigkeit in ein journalistisches Produkt übersetzt werden sollen, machen Algorithmen und automatisierte Abläufe Sinn.

Das publizistische Resultat muss allerdings nicht immer eine Textumsetzung sein. Auch automatisch generierte Grafiken und Visualisierungen können aus regelmässigen Daten produziert werden. Ein solches Beispiel ist die Visualisierung der geolokalisierten Google-Anfragen. Ähnliche Umsetzungen könnte man sich bei Verkehrsflüssen (Stau, öffentlicher Verkehr und Pendler) oder Wetterdaten vorstellen. Aufgrund von Livedaten lassen sich in diesen Bereichen journalistische Geschichten generieren. So schlägt zum Beispiel ein Algorithmus Alarm, wenn die Datenbewegungen vom Normalbereich abweichen.

Ziemlich ähnlich könnten Algorithmen auch bei der Kuration – also der automatisierten Zusammenstellung von bereits im Web veröffentlichten Inhalten – eingesetzt werden. Man stelle sich einen abonnierbaren Dienst vor, ähnlich Google News und Google Alerts, der zu spezifischen Themen laufend die neusten Publikationen herausfiltert, zusammenfasst und redaktionell aufbereitet. Medienzusammenstellungen und mühsame Themenrecherchen könnten so um einen grossen Teil vereinfacht werden.

Algorithmen bei Publikation und Moderation

Der Lebenszyklus von News ist nach der Artikelpublikation im Netz längst nicht abgeschlossen. Auch nach der Veröffentlichung können Algorithmen das Leben von Journalisten erleichtern. Sei dies bei der viralen Verbreitung via Social Media oder bei der Moderation des eintreffenden Feedbacks.

Mit Aufkommen von Buzzfeed, Upworthy und weiteren Clickbaiting-Seiten halten auch A-/B-Tests in Redaktionen Einzug. Unzählige Unternehmen haben sich dieses aus der PR-Branche stammende Phänomen längst zunutze gemacht und algorithmenbasierte Software entwickelt. Was angewandt im Redaktionsalltag natürlich auch zu unschönen Auswüchsen führen kann.

Wie weit die Integration von Algorithmen und Datenanalyse im Redaktionsalltag gehen kann, zeigt die Huffington Post. Mit rund 90 Millionen Lesern im Monat und rund 500 bis 1600 produzierten News-Artikeln am Tag steht Huffington Post auf Platz 84 der meistbesuchten Websites. Dank Schlüsselwörtern, Verweisen, Kommentaren, Social Media-Links und weiteren Faktoren können sich die Datenanalysten bei HuffPo ein viel detaillierteres Bild der Leserschaft formen. Die Daten sind das eine, was die Journalisten und die Redaktion insgesamt daraus macht das andere.

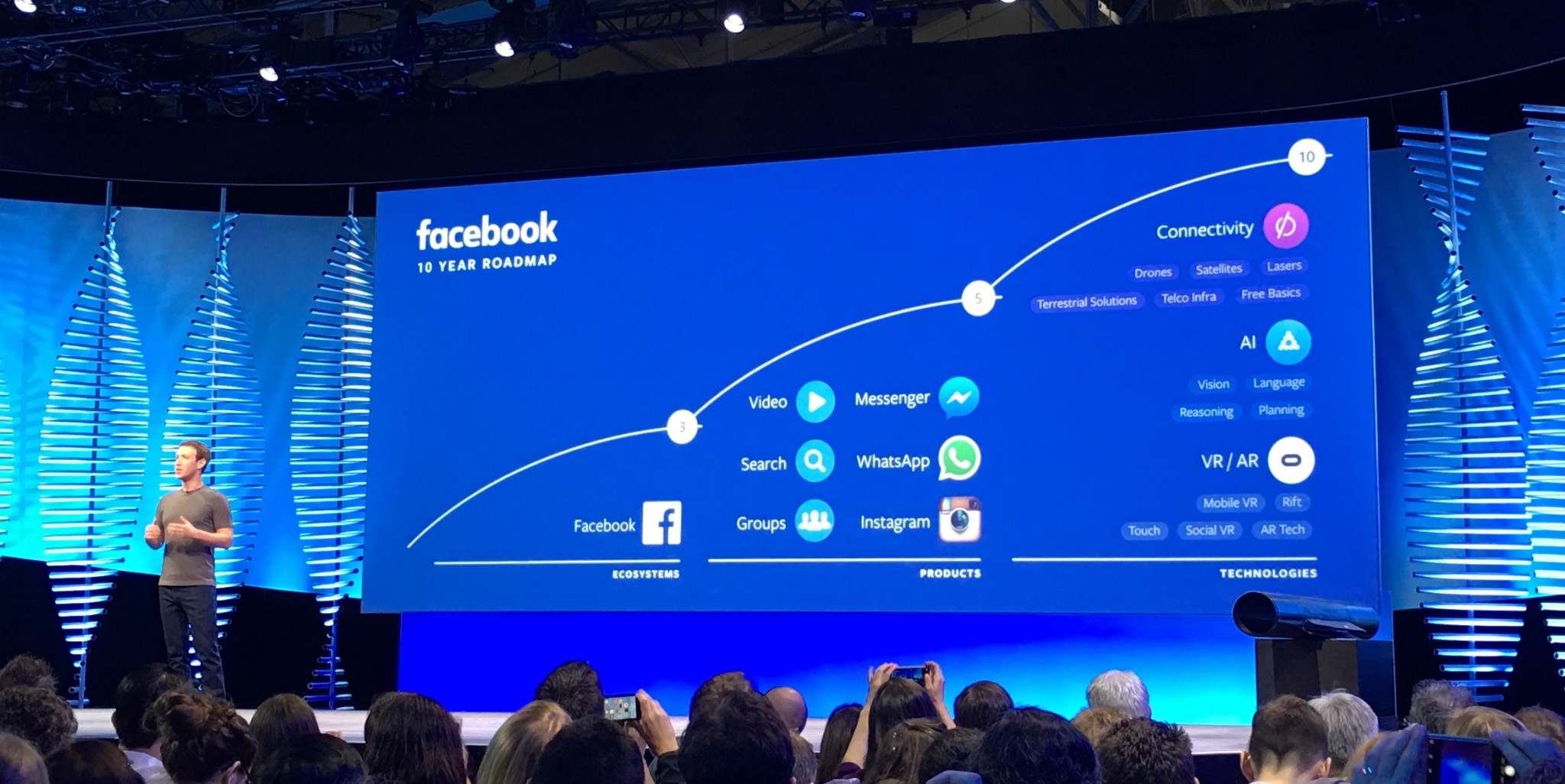

Kommt hinzu, dass viele Inhalte, die via Social Media geteilt werden, von den Usern gar nie gesehen werden. Auch dies hat mit einem Algorithmus zu tun. Der bekannteste unter ihnen ist der von Facebook. Immer wieder zeigt sich, dass bereits kleinste Änderungen am Code für deutliche Auswirkungen auf die Sichtbarkeit der Inhalte von Newsplattformen sorgen. Jüngst hat auch Facebook einen Teil seines Codes für A-/B-Tests freigegeben, doch das Vorgehen ist noch immer intransparent. Aufgrund dessen fragt sich Kelly McBride des Poynter Instituts zurecht, ob diese Algorithmen nicht gar unsere Demokratien gefährden. Umso wichtiger sind klare ethische Richtlinien, an welche sich auch Programmierer im journalistischen Umfeld halten müssen. Mehr dazu im letzten Absatz.

Schliesslich können Algorithmen Journalisten auch in der Community-Arbeit und bei der Moderation des Feedbacks unterstützen. 2012 registrierte die Huffington Post über 70 Millionen Kommentare auf ihrer Seite. Obwohl 30 Vollzeit-Moderatoren diese Meldungen einzeln bearbeiten, ist die hohe Anzahl an Inputs niemals von Hand zu bewerkstelligen. Auch hier hilft ein Algorithmus: «JuLiA» («Just a Linguistic Algorithm»), eine semantische Lösung, die mehrere Sprachen beherrscht und somit Kommentare automatisch auswertet. Weiter kann der Algorithmus je nach Kommentarverhalten auch Abzeichen und andere Artikelvorschläge generieren. (Anm. erst gestern hat HuffPo angekündigt, künftig sämtliche Kommentare über die Kommentarfunktion von Facebook abdecken zu wollen.)

Algorithmen im Redaktionsalltag verlangen Transparenz

Mehr als je zuvor muss in all diesen Bereichen grösstmögliche Transparenz über die Entstehung und Aufbereitung der Information hergestellt werden. Lorenz Matzat fordert dazu etwa einen Presseausweis für Roboterjournalisten. Es geht ihm dabei weniger um die Personifizierung als vielmehr um die Symbolik: Pressekodizes gelten auch für Algorithmen, bzw. deren Programmierer. Matzat unterbreitet ausserdem den Vorschlag, die drei Robotergesetze von Isaac Asimov auch im Redaktionsalltag anzuwenden.

Egal ob manuell hergestellt oder algorithmenbasiert: Auch in Zukunft werden Leser aufgrund ihres Vertrauens zum Medium und der Art der Berichterstattung entscheiden, ob sie ein Angebot nutzen.

Fragen zum Einsatz von journalistischen Algorithmen

Wer Algorithmen journalistisch einsetzt, sollte folgende Fragen beantworten können:

- Welches ist die Basis, worauf algorithmische Entscheide gefällt werden?

- Werden spezifische Informationen bewusst ausgefiltert?

- Wie fliessen die verschiedenen Kriterien in die Entscheide des Algorithmus ein?

- Liegt eine verzerrende Gewichtung, Klassifizierung oder Verbindung der Einflussfaktoren vor?

- Wo liegen die Grenzen des Algorithmus?

- Wann funktioniert der Algorithmus nicht mehr und wie ist die Fehlerbenachrichtigung organisiert?

tl;dr: Roboterjournalismus sollte Journalisten nicht einschüchtern. Vielmehr erleichtern automatisierte Prozesse basiert auf programmierten Algorithmen die Recherche, Produktion und Moderation von redaktionellen Inhalten.

Weitere Artikel zum Thema

- In einem Bericht am Tow Center for Digital Journalism schreibt Nicholas Diakopoulos über die Verantwortung der algorithmenbasierten Berichterstattung.

- Lorenz Matzat trägt in einer zweiteiligen Serie aktuelle Beispiele zum Thema Algorithmen im Journalismus zusammen. Seinen Vortrag an der re:publica 2014 zum Thema «Wenn Algorithmen Nachrichten machen» gibt es hier zum Nachschauen.

- In Deutschland will der ehemalige dapd-Chef Cord Dreyer ein eigenes Startup mit algorithmenbasierten Angeboten lancieren. Das Interview dazu in der SonntagsZeitung kann hier nachgelesen werden.

- Jan Tissler sammelt in einem ausführlichen Artikel Beispiele, wie Algorithmen bereits im Journalismus eingesetzt werden.

- Zum Schluss noch dies: Die Aussage, dass bis ins Jahr 2030 90 Prozent der News von Algorithmen geschrieben werden, stammt von Kristian Hammond, Co-Gründer von Narrative Science.

Update vom 15. Juni 2014: Für die «Schweiz am Sonntag» durfte ich vom «Global Editors Network» in Barcelona berichten. Den Artikel zur Konferenz mit Fokus «Roboterjournalismus» gibt es hier zum Nachlesen.

Inhaltsverzeichnis